앙상블 학습: Difference between revisions

From IT Wiki

No edit summary |

No edit summary |

||

| Line 6: | Line 6: | ||

=== 보팅 === | === 보팅 === | ||

;여러 모델에서 구해진 예측값들을 대상으로 다수결 투표를하여 최종 클래스를 예측 | ;여러 모델에서 구해진 예측값들을 대상으로 다수결 투표를하여 최종 클래스를 예측 | ||

[[파일:앙상블 학습.png| | [[파일:앙상블 학습.png|400px]] | ||

* 하드 보팅과 소프트 보팅 | * 하드 보팅과 소프트 보팅 | ||

Revision as of 01:19, 8 January 2020

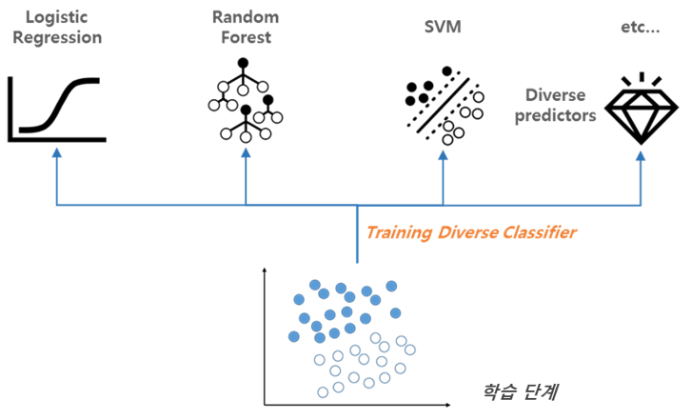

- Ensemble Learning

- 하나의 데이터를 여러개의 분류기를 통해 다수의 학습 모델을 만들어 학습시키고 학습 결과를 결합함으로써 과적합을 방지하고 정확도를 높이는 학습 기법

유형

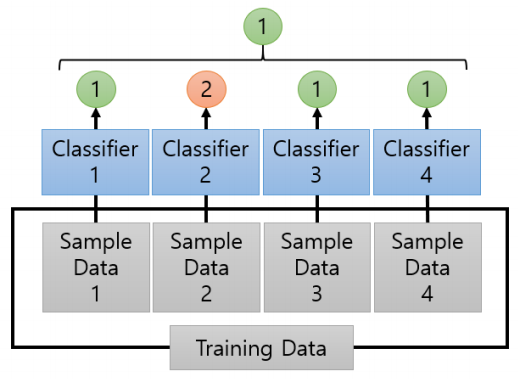

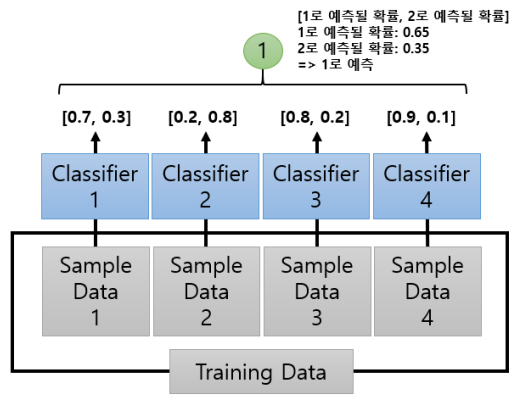

보팅

- 여러 모델에서 구해진 예측값들을 대상으로 다수결 투표를하여 최종 클래스를 예측

- 하드 보팅과 소프트 보팅

| 하드 보팅 | 소프트 보팅 |

|---|---|

|

|

| 예측 결과를 그대로 보팅 | 예측 확률의 평균값으로 보팅 |

배깅

- 배깅(Bagging)은 Bootstrap Aggregating의 줄임말

- 부트스트래핑: 학습 데이터셋에서 중복을 허용하여 랜덤하게 추출하는 방식(aka. 리샘플링)

- 페이스팅: 학습 데이터셋에서 중복 없이 랜덤하게 추출하는 방식

- 배깅은 부트스트래핑을 이용한 앙상블 학습법

- 장점: 분산 감소

- 단점: 중복으로 인해, 특정 샘플은 사용되지 않고 특정 샘플은 여러번 사용되어 편향될 가능성

- OOB(Out-of-Bag) 샘플: 샘플링 되지 않은 나머지 샘플

부스팅

- 성능이 약한 학습기(weak learner)를 여러 개 연결하여 강한 학습기(strong learner)를 만드는 앙상블 학습기법

랜덤 포레스트

- 배깅을 적용한 의사결정 나무 앙상블 학습 기법

- 종류

| 종류 | 설명 |

|---|---|

| 아다부스팅

(AdaBoost) |

|

| 그래디언트 부스팅

(Gradient Boosting) |

|