활성화 함수: 두 판 사이의 차이

IT 위키

(새 문서: ;Activation Function == 종류 == * 시그모이드(Sigmoid) * 하이퍼볼릭 탄젠트(Hyperbolic Tangent, tanh)) * 렐루|ReLU(...) |

편집 요약 없음 |

||

| (같은 사용자의 중간 판 3개는 보이지 않습니다) | |||

| 1번째 줄: | 1번째 줄: | ||

[[분류:인공지능]] | |||

;Activation Function | ;Activation Function | ||

;[[인공 신경망]] 모델에서 입력값으로 받은 데이터를 다음 층으로 어떻게 출력할지를 결정하는 함수 | |||

== 종류 == | == 종류 == | ||

{| class="wikitable" | |||

* [[ | ! 구분 | ||

* [[ | ! 명칭 | ||

! 그래프 | |||

! 설명 | |||

|- | |||

| rowspan="3" | 단극성 | |||

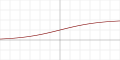

| Sigmoid | |||

| [[파일:활성화함수-시그모이드.png]] | |||

| 로지스틱 함수. x값을 변화에 따라 0~출력 | |||

|- | |||

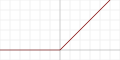

| ReLU | |||

| [[파일:활성화함수-렐루.png]] | |||

| x값이 음수일 땐 0 고정 | |||

|- | |||

| Softmax | |||

| 2차원 그래프로 표현 불가 | |||

| 여러 입력값을 0~1로 나누어 표현 | |||

|- | |||

| rowspan="3" | 양극성 | |||

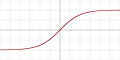

| tanh | |||

| [[파일:활성화함수-하이퍼볼릭탄젠트.png]] | |||

| Sigmod보다 기울기가 크며 1~1 범위를 가짐 | |||

|- | |||

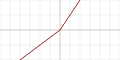

| LReLU | |||

| [[파일:활성화함수-리키렐루.png]] | |||

| 음수일 때 입력값의 1/10 출력 | |||

|- | |||

| Maxout | |||

| 2차원 그래프로 표현 불가 | |||

| 두 개의 W와 b중에서 큰 값 사용 | |||

|} | |||

== 같이 보기 == | |||

* [[인공 신경망]] | |||

* [[퍼셉트론]] | |||

2019년 10월 26일 (토) 23:23 기준 최신판

- Activation Function

- 인공 신경망 모델에서 입력값으로 받은 데이터를 다음 층으로 어떻게 출력할지를 결정하는 함수