트롤리 딜레마: 두 판 사이의 차이

IT 위키

(새 문서: 분류:인공지능 ;Trolley Problem; Trolley Dilemma ;동일한 상황에서 이성적 판단 VS 윤리적 판단 중 어느것이 옳은가의 문제 == 트롤리 문제 == ;Tr...) |

편집 요약 없음 |

||

| (같은 사용자의 중간 판 3개는 보이지 않습니다) | |||

| 4번째 줄: | 4번째 줄: | ||

== 트롤리 문제 == | == 트롤리 문제 == | ||

; | ;Trolley Problem | ||

;트롤리(기차)가 달려오고 있고, 선로에는 다수의 사람들이 있다. | |||

* | * '''문제1''': 당신은 레버를 당겨 선로를 조정할 수 있으나, 변경된 선로에는 1명이 있다. | ||

** [[파일:트롤리문제1.jpg|200px]] | |||

** 즉 선로 조작 시 한명의 희생으로 다수를 살릴 수 있다. | ** 즉 선로 조작 시 한명의 희생으로 다수를 살릴 수 있다. | ||

** 선로를 변경하는 것이 도덕적으로 용인되는가? | ** 선로를 변경하는 것이 도덕적으로 용인되는가? | ||

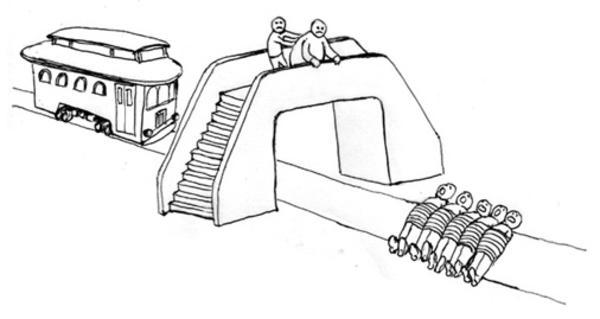

* 문제2: | * '''문제2''': 당신은 그보다 앞에, 선로 위에 무거운 사람과 같이 서 있다. | ||

** [[파일:트롤리문제2.jpg|200px]] | |||

** 무거운 사람을 밀어 선로에 | ** 무거운 사람을 밀어 선로에 떨어뜨리면 그 사람은 죽겠지만 다수의 사람을 살릴 수 있다. | ||

** 무거운 사람을 밀어 다수를 살리는 것이 도덕적으로 용인되는가? | ** 무거운 사람을 밀어 다수를 살리는 것이 도덕적으로 용인되는가? | ||

* 결과 | * '''결과''' | ||

** 문제1: 85%가 도덕적으로 용인 가능하다고 답변 | ** 문제1: 85%가 도덕적으로 용인 가능하다고 답변 | ||

** 문제2: 12%가 도덕적으로 용인 가능하다고 답변 | ** 문제2: 12%가 도덕적으로 용인 가능하다고 답변 | ||

* '''도덕적 판단의 기준''' | |||

** 생물학자 마크 하우저는 사람의 도덕적 판단이 이성보다는 감정의 영향을 받는다고 주장 | |||

:{| class="wikitable" | |||

{| class="wikitable" | |||

|- | |- | ||

! 구분 !! 설명 | ! 구분 !! 설명 | ||

| 30번째 줄: | 30번째 줄: | ||

|} | |} | ||

== 자율주행 자동차의 | == 현대 기술에서의 이슈 == | ||

; 자율주행 자동차를 운전하는 | === 드론의 조종사의 감정 === | ||

* 직접 총을 쏘지 않고 드론이나 무인항공기로 사람을 죽이는 조종사는 상대적으로 낮은 죄책감을 느낌 | |||

* 도덕적 판단이 필요한 순간에 감정의 영향을 적게 받고, 좀 더 쉽게 의사결정을 이룸 | |||

=== 자율주행 자동차의 판단 === | |||

; 자율주행 자동차를 운전하는 인공지능은 어떤 선택을 할 것인가? | |||

* 고속 이동중인 차량 앞에 어린아이 등장, 회피 시 운전자의 사망위험이 큼 | * 고속 이동중인 차량 앞에 어린아이 등장, 회피 시 운전자의 사망위험이 큼 | ||

* 차량은 어린아이 또는 운전자 중 희생자를 골라야 함 | * 차량은 어린아이 또는 운전자 중 희생자를 골라야 함 | ||

== 모랄 머신 == | == [[모랄 머신]] == | ||

; Moral Machine | ; Moral Machine | ||

* MIT 공대 lyad Rahwan의 Scalable Cooperation 그룹이 개발한 온라인 플랫폼으로 도덕적 딜레마를 발생시키고 사람들이 두 가지 결과 사이에서 내린 정보를 수집하여 분석. | |||

* 시나리오는 트롤리 딜레마의 다양한 사례를 활용하며, 수집된 정보는 향후 기계학습이 갖추고 있어야 할 도덕적 가치를 부여하는 데 이용됨 | |||

2019년 10월 7일 (월) 01:05 기준 최신판

- Trolley Problem; Trolley Dilemma

- 동일한 상황에서 이성적 판단 VS 윤리적 판단 중 어느것이 옳은가의 문제

트롤리 문제[편집 | 원본 편집]

- Trolley Problem

- 트롤리(기차)가 달려오고 있고, 선로에는 다수의 사람들이 있다.

- 문제1: 당신은 레버를 당겨 선로를 조정할 수 있으나, 변경된 선로에는 1명이 있다.

- 문제2: 당신은 그보다 앞에, 선로 위에 무거운 사람과 같이 서 있다.

- 결과

- 문제1: 85%가 도덕적으로 용인 가능하다고 답변

- 문제2: 12%가 도덕적으로 용인 가능하다고 답변

- 도덕적 판단의 기준

- 생물학자 마크 하우저는 사람의 도덕적 판단이 이성보다는 감정의 영향을 받는다고 주장

구분 설명 행동의 원리 행동함으로써 일어난 폐해(가령 누군가의 죽음)는 행동하지 않아 일어난 폐해보다 더 비도덕적이라고 판단 의도의 원리 의도적으로 한 행동이 의도적이지 않은 행동보다 더 비도덕적이라고 판단 접촉의 원리 직접적 신체 접촉이 수반되는 위해가 그렇지 않은 위해보다 더 비도덕적이라고 판단

현대 기술에서의 이슈[편집 | 원본 편집]

드론의 조종사의 감정[편집 | 원본 편집]

- 직접 총을 쏘지 않고 드론이나 무인항공기로 사람을 죽이는 조종사는 상대적으로 낮은 죄책감을 느낌

- 도덕적 판단이 필요한 순간에 감정의 영향을 적게 받고, 좀 더 쉽게 의사결정을 이룸

자율주행 자동차의 판단[편집 | 원본 편집]

- 자율주행 자동차를 운전하는 인공지능은 어떤 선택을 할 것인가?

- 고속 이동중인 차량 앞에 어린아이 등장, 회피 시 운전자의 사망위험이 큼

- 차량은 어린아이 또는 운전자 중 희생자를 골라야 함

모랄 머신[편집 | 원본 편집]

- Moral Machine

- MIT 공대 lyad Rahwan의 Scalable Cooperation 그룹이 개발한 온라인 플랫폼으로 도덕적 딜레마를 발생시키고 사람들이 두 가지 결과 사이에서 내린 정보를 수집하여 분석.

- 시나리오는 트롤리 딜레마의 다양한 사례를 활용하며, 수집된 정보는 향후 기계학습이 갖추고 있어야 할 도덕적 가치를 부여하는 데 이용됨