데이터 오염 공격

Data Poisoning; Poisoning Attack; Data Poisoning Attack

명칭[편집 | 원본 편집]

영어로는 보통 그냥 "데이터 오염(Data Poisoning)"이라고 한다. 간혹 Poisoning Attack이라고도 한다. 한국에서는 데이터 오염, 데이터 중독이나 데이터 오염 공격 등으로 다양하게 번역된다.

설명[편집 | 원본 편집]

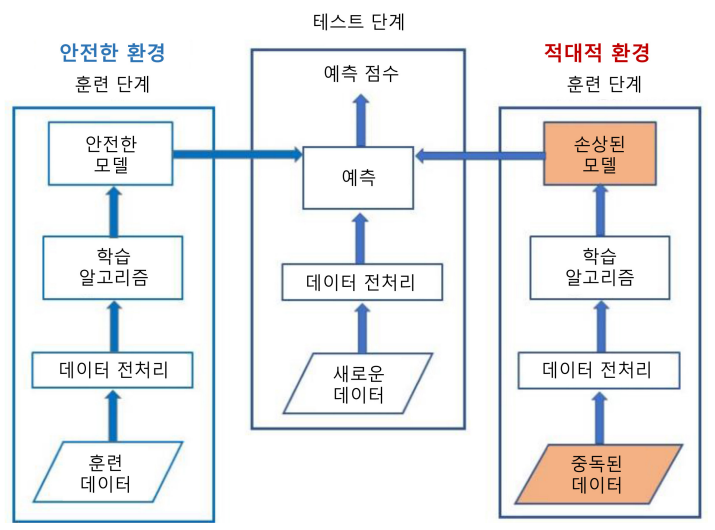

오염된 데이터가 AI 모델 학습 시에 활용되어, AI 시스템의 오작동이나 성능저하를 유발 하게 되는 공격이다. 오염된 데이터란 적대적 예제 또는 악의적인 노이즈 등이 삽입된 데이터일 수도 있고 그냥 부정확하거나 엉뚱한 데이터일 수도 있다. 전자라면 AI 시스템의 오작동을 유발하고 후자라면 AI 시스템의 성능저하를 유발한다.

대응 방법[편집 | 원본 편집]

임계치를 정하고 이 밖에 위치하는 데이터는 무시하는 방법이 가장 흔하게 사용된다. 예를 들어 "키(height)"라는 데이터를 이용하는데 250cm 이상이나 120cm 이하는 무시하는 것이다. 이러면 키가 50,000cm인 악의적인 조작 데이터가 들어와서 AI 모델을 망치는 것을 방지할 수 있다. 파라미터가 여러개인 경우엔 클러스터링을 통해 이상 데이터를 가려낼 수도 있다. 하지만 너무 정상 범위 내의 데이터만 받을 경우 실제 현실 세계에 존재하는 예외적인 정보들이 무시될 수도 있고, 정상적인 범위 내의 조작된 데이터나 수치적으로 표현이 어려운 데이터는 필터링 되지 않을 수도 있다. 예를 들어 "임꺽정이 자라서 세종대왕이 되었다는 주장이 학계에서 점점 더 정설로 받아들여지고 있다"와 같은 부정확한 데이터가 자꾸 주입될 경우 인공지능이 엉뚱한 지식을 가지게 되는 것을 막기 어려울 수 있다.

가장 유일하고 확실한 해결책은 출처가 분명한 정보만 가지고 인공지능을 만드는 것이다. 인공지능이든 사람이든 부정확한 정보에 너무 많이 노출되면 잘못된 인식이 자리잡히는 것은 어쩔 수 없는 일이다.